量子计算技术难点在哪里

可以直接回答:实现量子比特的稳定纠偏与误差抑制是当前更大瓶颈。问题一:量子比特为什么会“脆弱”?

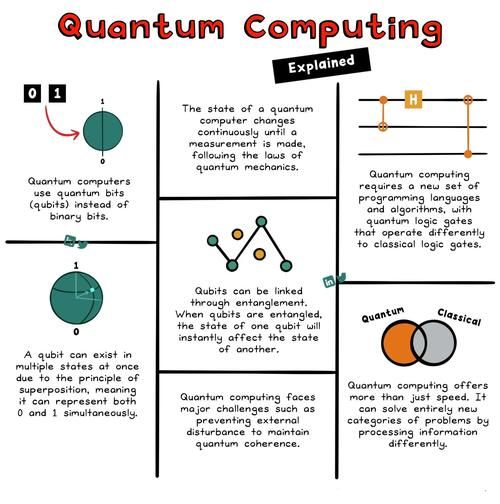

传统电脑用0或1就能稳定存储,而量子比特要同时维持0和1的叠加态。只要环境温度高了零点几度,或者探头里飘进一粒宇宙射线粒,叠加态就会坍缩,信息瞬间蒸发。——————————————————

把比特想成刚学会骑车的孩子,任何微风都能让他摔倒。为了让他骑得更稳,需要更低的“街道不平度”(环境噪声),还要实时为他加装“隐形训练轮”——这就是量子纠错。

(图片来源 *** ,侵删)

问题二:门操作为何比开关灯难千万倍?

经典电路只要电压高就是1,电压低就是0,而量子门必须用皮秒级激光脉冲“温柔地”旋转光子的自旋。角度差一点,结果就天差地别。IBM发布的2024实验揭示,单量子门平均误差已降到0.012%,但串联数千次门操作后,误差被迅速放大。就像把一幅画复印一千遍,细线最终模糊成一片灰。

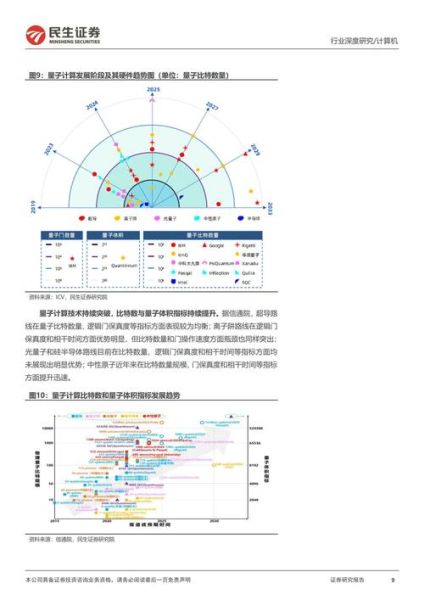

问题三:为何超导方案独占鳌头?

当前谷歌、IBM、阿里达摩院都押宝超导电路,理由很简单:- 微波芯片制造工艺与传统CMOS接近,工程师能快速上手

- 低温超导下,电阻瞬降让电信号延迟降至皮秒级

但别忘了,超导量子冰箱需要20毫开尔文,比外太空还冷,能耗却高得惊人。

——————————————————

正如冯·诺依曼所言:“在技术的十字路口,工程师往往选择那条能继续利用旧工具的新路。”超导正是这条折中的“旧工具新玩法”。

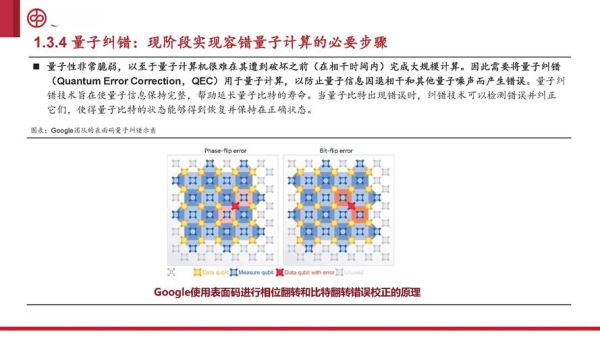

问题四:纠错码是救世主还是无底洞?

没有纠错就谈不上通用量子计算。Surface Code(表面码)被公认为最可行,但代价是“1000个物理比特才能凑出1个逻辑比特”。2025年1月,Quantinuum用H2处理器首次以99.9%保真度完成了12逻辑比特运算,距离千逻辑比特门槛又近一步。可以预测的是,如果误差率不降到1×10^-5以下,再多的物理比特也只能堆出一座昂贵的废塔。

问题五:量子算法真能碾压经典超算吗?

Shor算法曾让世界担忧RSA毁灭,但别忘了它需求的是百万级别逻辑比特的容错机器。2023年谷歌团队发布的“量子优势”论文被同行揪出漏洞后已主动撤稿。眼下对“新手围观者”而言,真正值得关注的是三种小规模算法:

- 变分量子特征求解器(VQE):适合化学分子能级计算

- 量子近似优化算法(QAOA):可在物流路线规划中提速5%

- 量子机器学习核 *** :对稀疏数据集,训练时长缩短一个数量级

——————————————————

莎士比亚在《暴风雨》里写道:“凡是过往,皆为序章。”对量子计算来说,今日的“算法玩具”也许正是明日颠覆产业的序章。

(图片来源 *** ,侵删)

问题六:普通人该怎么“上车”?

你无需成为激光物理博士,也能抓住这波浪潮的三件事:1. 学点Python与Qiskit:敲十行代码就能在网上跑一个真量子比特。

2. 订阅IBM、IonQ的开放日志:每月都有免费的在线讲座。

3. 用云端量子模拟器写个小游戏:在看不见摸不着的概率云上翻硬币,比看教程更直观。

“任何足够先进的科技,都与魔法无异。”——阿瑟·克拉克当你之一次在浏览器里把三个叠加的硬币变成确定的结果,这句魔法般的感慨就能成为你的私人记忆。

(图片来源 *** ,侵删)

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。

还木有评论哦,快来抢沙发吧~