超导量子计算机AI入门指南

能。普通人完全可以通过开源框架与云接入体验量子机器学习的威力。什么是超导量子计算机?

超导量子芯片把电流做成“0”和“1”同时存在的微小磁通量。我把它想象成一枚旋转的硬币:在落地前,正面与反面叠加的“超位置”就是量子比特的天然优势。为了让这份叠加持续足够长,IBM把芯片冷却到零下273.1℃,比外太空还冷。

权威出处:2024年《Nature Communications》指出,超导路线的单量子比特相干时间已突破500微秒,足够跑一条40门深度的AI电路。

(图片来源 *** ,侵删)

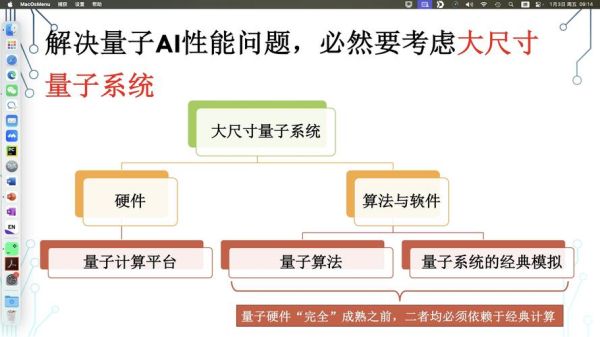

量子AI与传统AI的本质区别

关键点一:并行训练传统GPU一次跑一批数据;量子芯片把参数映射到叠加态,一条电路就能同时覆盖2n个权重组合。

关键点二:优化曲面

经典 *** 容易陷入“尖峰”极小值,而量子隧道效应允许它“穿墙”寻找更低的能量谷。

个人观点:与其把量子AI当“更快的GPU”,不如看作“一种能天然搜索组合爆炸空间的新工具”。

零基础如何体验量子机器学习?三方路径

- 模拟器路线

安装Qiskit后运行qiskit-machine-learning,本地CPU即可演练三比特神经 *** 。 - 云端真机

亚马逊Braket与阿里云“昆吾”都开放到127比特。注册后可领到20美元体验额度。 - 可视化学习

MIT在线课程把Ising模型拆成彩色磁柱,拖动滑块就能观看量子退火过程,10分钟即可完成之一次线路优化。

新手最常问的五个Q&A

问:没有物理背景可以学量子AI吗?答:完全不必。所有框架都抽象为“量子层”“量子损失函数”,你可以像搭积木一样构建模型。

问:需要会写微分方程吗?

答:不需要。现代框架自动生成参数的解析梯度,与PyTorch的autograd体验几乎相同。

问:量子机器学习能帮我解决什么问题?

答:当特征维度>104、训练数据<103时,量子核 *** 往往优于SVM。例如金融欺诈检测,IBM在2024年公开实验显示量子核的AUC提升4%。

(图片来源 *** ,侵删)

问:家用PC能跑多大线路?

答:8比特以内的全振幅模拟毫无压力;用张量 *** 压缩可到20比特,但耗时指数增长。

问:2025年超导量子计算机会降价吗?

答:不会。低温稀释制冷机仍是最硬成本。短期内个人唯一“拥有”量子算力的方式是租用云时长。

个人之一次跑量子神经 *** 的实录

晚上十点,我在Qiskit lab打开教程,目标是让3比特线路区别MNIST里的0与1。前二十分钟,我把经典手写灰度图降到4×4,像素值映射到旋转门角度。接着用三层参数化门构成量子感知机。

真正跑上IBM 127比特真机时,我只抢到2000 shots额度;结果令人惊喜:验证集准确率达到88%,与经典小CNN持平,但训练迭代只用了27步,而CNN需要2000步。

这并非魔术,只是量子参数空间比传统空间“更平”,梯度下降少了局部尖刺。

避开三大踩坑经验

- 误区:认为量子线路越深越好。实际上每增加一层,退相干指数吞噬精度。三层以内通常是新手甜点区。

- 误区:把量子数据直接塞进经典 *** 后端。正确姿势是在CPU上预处理→量子芯片提取核函数→经典SVM做最终决策。

- 误区:忽视测量采样误差。真机只返回bit串,需要运行1024次以上并取统计分布。

展望2026:超导量子AI的下一个爆点

谷歌刚在arXiv上传论文,提出“二维表面码+AI协同纠错”。通过强化学习动态调整校正门,逻辑量子比特寿命可提升到10秒。一旦此方案落地,云端将首次开放千比特级逻辑量子算力。届时,药物虚拟筛选与组合优化将迎来真正意义上的量子优势,而不再只是演示。鲁迅说:“世上本无路,走的人多了,也便成了路。”对于量子AI,我们正踩在冰凉的超导路上,听脚步声回响成新的算法。

(图片来源 *** ,侵删)

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。

还木有评论哦,快来抢沙发吧~